Openai的绘图模型DALL-E入门测试

最近由于公司的一些需求需要尝试一下ai绘图功能,在midjourney和openai的DALL-E之间选择了对新用户更加友好的DALL-E进行测试

1.模型部署

通过api调用openai接口部署到web。。。。省略一万字,最终结果差不多是这样的:

DALL-E模型部署完毕接下来开始测试业务。

DALL-E模型部署完毕接下来开始测试业务。

2.业务绘图能力

测试1:通过简单的中文输入是否能得到需要的结果

结论1:基本完全无法理解中文语义,或者说DALL-E训练的数据库极少包含中文。

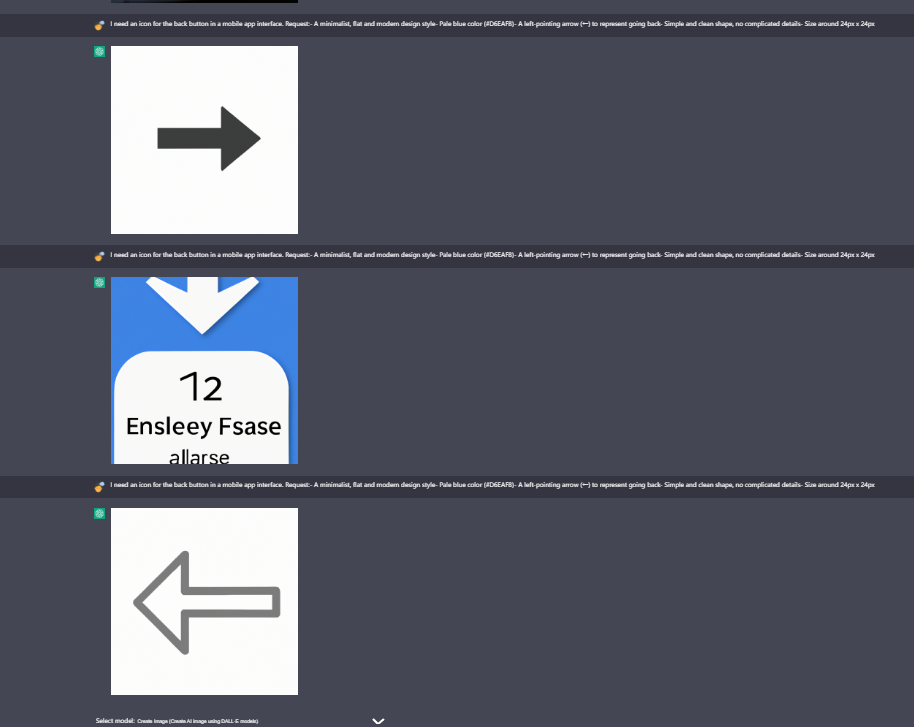

测试2:使用英文,使用更加专业描述

问:

I need an icon for the back button in a mobile app interface. Request:- A minimalist, flat and modern design style- Pale blue color (#D6EAF8)- A left-pointing arrow (←) to represent going back- Simple and clean shape, no complicated details- Size around 24px x 24px

结果是这样的:

结论2:更加专业的英文描述可以获得更加准确的结果,但是任然不准确,因此专业的prompt工程师确实是必要的。

测试3:先让AI生成描述文本,再使用描述文本让AI绘图

先通过AI 生成描述文本:

我在做一个图形界面想要DALLE帮我绘制一组前进和后退图标,要求是淡蓝色,我应该怎么用英文描述

结果:

一个聪明的对话模型在文本描述这类工作中确实能有出色的表现。

一个聪明的对话模型在文本描述这类工作中确实能有出色的表现。

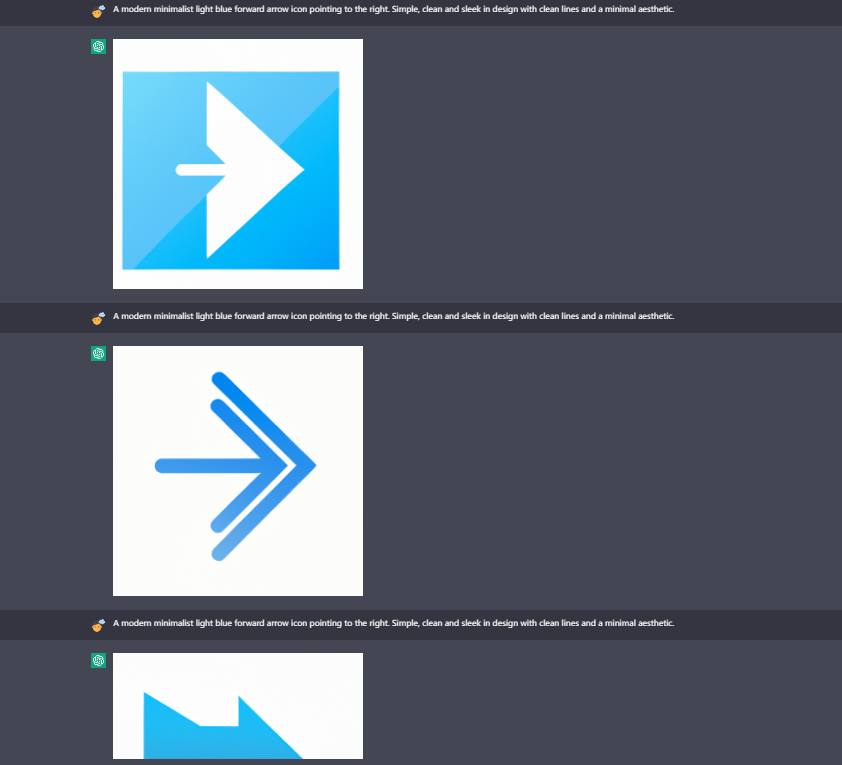

再将ai的回答导入到DALL-E,结果是这样的:

结论3:经过详细的描述和正确的引导,貌似也能画一些不错的图,甚至有一些设计是很惊喜的。

3.结论

Openai 的DALL-E模型也并不能算得上是开箱即用,直接输入并不能得到理想的结果(可能是我语文和英语都不好),但是在对话模型的加持下,即便是普通人也能够通过不断地与AI对话来优化输入,从而获取一个更稳定的输出。

这里提供一些测试网站供大家使用,模型是OpenAI的DALL-E:

底部Select model 需要选择DALL-E

有效期截至23年7月1日

题外话

每一周,都有大小公司在推出自己的大模型,AI 颠覆世界不再被当成遥远的想象。可以在各个领域代替人工的通用人工智能(AGI,artificial general intelligence)似乎随时就会诞生。

相似的 AI 狂热,历史上有过几次。最近一次是 2016 年春天,Google 旗下 DeepMind 开发的 AlphaGo 大胜围棋大师李世石。人们期待 AI 会快速跨行业复制、应用,颠覆已有的许多生意,甚至带来更大的社会变化。

有意思的是:

学会使用一个正在快速进化的黑箱工具,是人类以前没有遇到过的课题

By Piper

2023.06.08